什么是决策树?决策树的优缺点是什么?

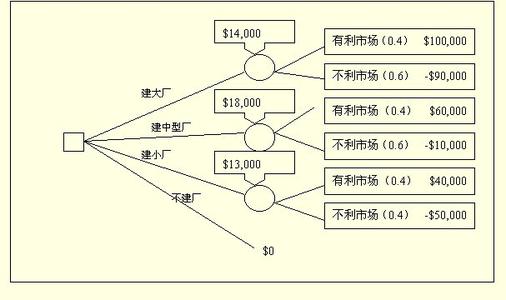

由状态节点引出的分支称为概率枝,概率枝的数目表示可能出现的自然状态数目每个分枝上要注明该状态出现的概率

决策树是怎么样的作用?

决策树是一种用树枝状展现数据受各变量的影响情形之预测模型,根据对目标变量产生之效应的不同而建构分类的规则,一般多运用在对客户数据的分析上,例如针对有回函与未回含的邮寄对象找出影响其分类结果的变量组合,常用分类方法为CART(ClassificationandRegressionTrees)及CHAID(ChiSquareAuto*ticInteractionDetector)两种

决策树法的例题

某厂区建设**,共分道路(甲)、厂房(乙)、办公楼(丙)3个标段进行招标建设,投标人只能选择其中一个标段参与投标。预期利润及概率见下表。若未中标,购买招标文件、图纸及人工费、利息支出合计为5000元。 方案及结果 中标、落标概率 效果 预期利润(万元) 预期利润概率 甲标段高价中标 0.2 赚 200 0.3 一般 50 0.6 赔 -20 0.1 甲标段高价落标 0.8 赔 -0.5 / 甲标段低价中标 0.4 赚 160 0.2 一般 40 0.6 赔 -30 0.2 甲标段低价落标 0.6 赔 -0.5 / 乙标段高价中标 0.3 赚 250 0.2 一般 80 0.7 赔 -30 0.1 乙标段高价落标 0.7 赔 -0.5 / 乙标段低价中标 0.5 赚 200 0.1 一般 60 0.7 赔 -40 0.2 乙标段低价落标 0.5 赔 -0.5 / 丙标段高价中标 0.1 赚 300 0.3 一般 100 0.5 赔 -40 0.2 丙标段高价落标 0.9 赔 -0.5 / 丙标段低价中标 0.3 赚 240 0.2 一般 70 0.5 赔 -50 0.3 丙标段低价落标 0.7 赔 -0.5 / 解:(1)绘制决策树

依据表格数据绘制决策树,并将方案标于方案枝,概率标于概率枝,预期利润标于终点,见图5-1;

(2)计算损益期望值

计算各节点处的损益期望值,E=∑ G·P,并标注于相应的节点上方,

E7 = 200 × 0.3+50 × 0.6+(-20) × 0.1 = 88, E1 = 88 × 0.2+(-0.5) × 0.8 = 17.2,

E8 = 160 × 0.2+40 × 0.6+(-30) × 0.2 = 50, E2 = 50 × 0.4+(-0.5) × 0.6 = 19.7,

E9 = 250 × 0.2+80 × 0.7+(-30) × 0.1 = 103, E3 = 103 × 0.3+(-0.5) × 0.7 = 30.55,

E10 = 200 × 0.1+60 × 0.7+(-40) × 0.2 = 54, E4 = 54 × 0.5+(-0.5) × 0.5 = 26.75,

E11 = 300 × 0.3+100 × 0.5+(-40) × 0.2 = 132, E5 = 132 × 0.1+(-0.5) × 0.9 = 12.75,

E12 = 240 × 0.2+70 × 0.5+(-50) × 0.3 = 68, E6 = 68 × 0.3+(-0.5) × 0.7 = 20.05;

(3)比较各方案节点的损益期望值

*x {E1,E2,E3,E4,E5,E6} = *x {17.2,19.7,30.55,26.75,12.75,20.05} = E3;

(4)结论

节点3的期望值最大,故从损益期望值的角度分析,应选乙标段投标并以高价报价最为有利。

决策树的适用范围是什么?

决策树的适用范围:

科学的决策是现代管理者的一项重要职责。我们在企业管理实践中,常遇到的情景是:若干个可行性方案制订出来了,分析一下企业内、外部环境,大部分条件是己知的,但还存在一定的不确定因素。每个方案的执行都可能出现几种结果,各种结果的出现有一定的概率,企业决策存在着一定的胜算,也存在着一定的风险。这时,决策的标准只能是期望值。即,各种状态下的加权平均值。

针对上述问题,用决策树法来解决不失为一种好的选择。

决策树法作为一种决策技术,已被广泛地应用于企业的**决策之中,它是随机决策模型中最常见、最普及的一种规策模式和方法此方法,有效地控制了决策带来的风险。所谓决策树法,就是运用树状图表示各决策的期望值,通过计算,最终优选出效益最大、成本最小的决策方法。决策树法属于风险型决策方法,不同于确定型决策方法,二者适用的条件也不同。应用决策树决策方法必须具备以下条件:

1、具有决策者期望达到的明确目标;

2、存在决策者可以选择的两个以上的可行备选方案;

3、存在着决策者无法控制的两种以上的自然状态(如气候变化、市场行情、经济发展动向等);

5、不同行动方案在不同自然状态下的收益值或损失值(简称损益值)可以计算出来;

6、决策者能估计出不同的自然状态发生概率。

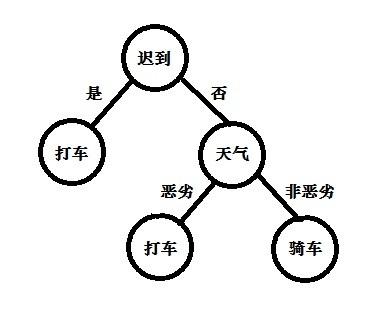

决策树(decisiontree)一般都是自上而下的来生成的。每个决策或事件(即自然状态)都可能引出两个或多个事件,导致不同的结果,把这种决策分支画成图形很像一棵树的枝干,故称决策树。